- 1.06 MB

- 2022-04-22 11:16:34 发布

- 1、本文档共5页,可阅读全部内容。

- 2、本文档内容版权归属内容提供方,所产生的收益全部归内容提供方所有。如果您对本文有版权争议,可选择认领,认领后既往收益都归您。

- 3、本文档由用户上传,本站不保证质量和数量令人满意,可能有诸多瑕疵,付费之前,请仔细先通过免费阅读内容等途径辨别内容交易风险。如存在严重挂羊头卖狗肉之情形,可联系本站下载客服投诉处理。

- 文档侵权举报电话:19940600175。

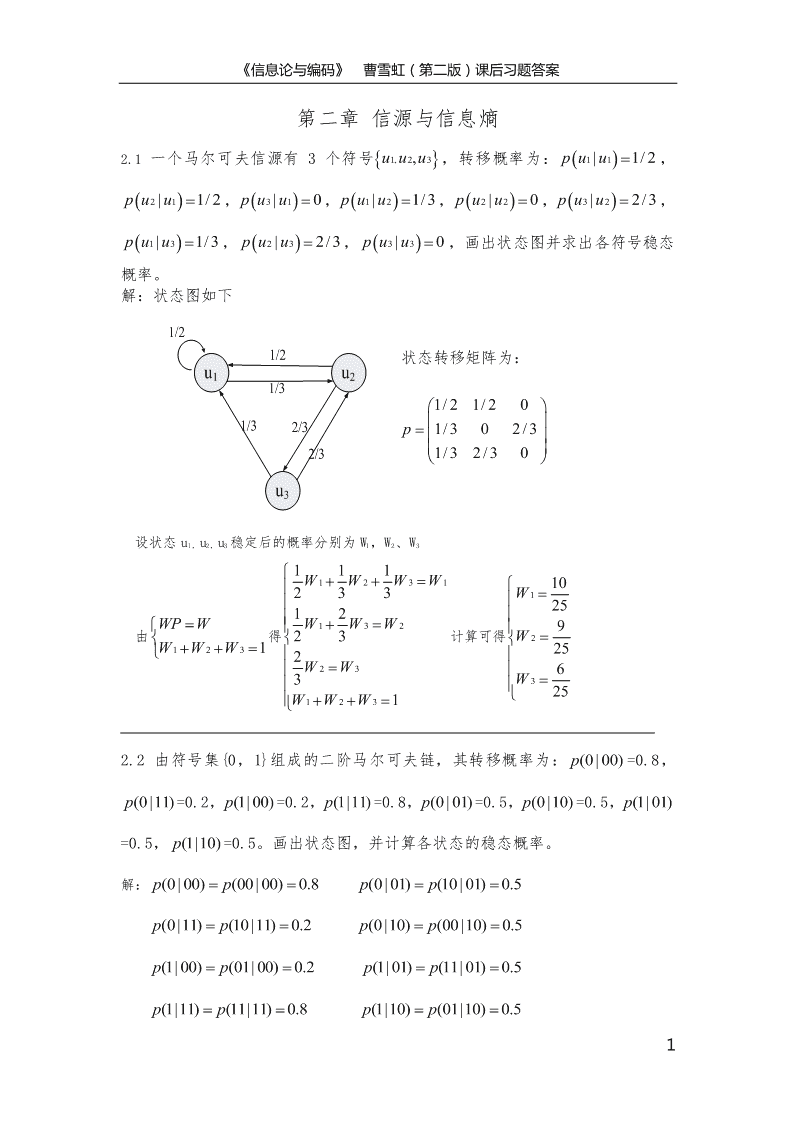

'《信息论与编码》曹雪虹(第二版)课后习题答案第二章信源与信息熵2.1一个马尔可夫信源有3个符号uuu1,2,3,转移概率为:puu11|1/2,puu21|1/2,puu31|0,puu12|1/3,puu22|0,puu32|2/3,puu13|1/3,puu23|2/3,puu33|0,画出状态图并求出各符号稳态概率。解:状态图如下1/21/2状态转移矩阵为:u1u21/31/21/201/32/3p1/302/32/31/32/30u3设状态u1,u2,u3稳定后的概率分别为W1,W2、W3111W1W2W3W110233W12512WPWW1W3W29由得23计算可得W2W1W2W31252WW2363W325W1W2W312.2由符号集{0,1}组成的二阶马尔可夫链,其转移概率为:p(0|00)=0.8,p(0|11)=0.2,p(1|00)=0.2,p(1|11)=0.8,p(0|01)=0.5,p(0|10)=0.5,p(1|01)=0.5,p(1|10)=0.5。画出状态图,并计算各状态的稳态概率。解:pp(0|00)(00|00)0.8pp(0|01)(10|01)0.5pp(0|11)(10|11)0.2pp(0|10)(00|10)0.5pp(1|00)(01|00)0.2pp(1|01)(11|01)0.5pp(1|11)(11|11)0.8pp(1|10)(01|10)0.51

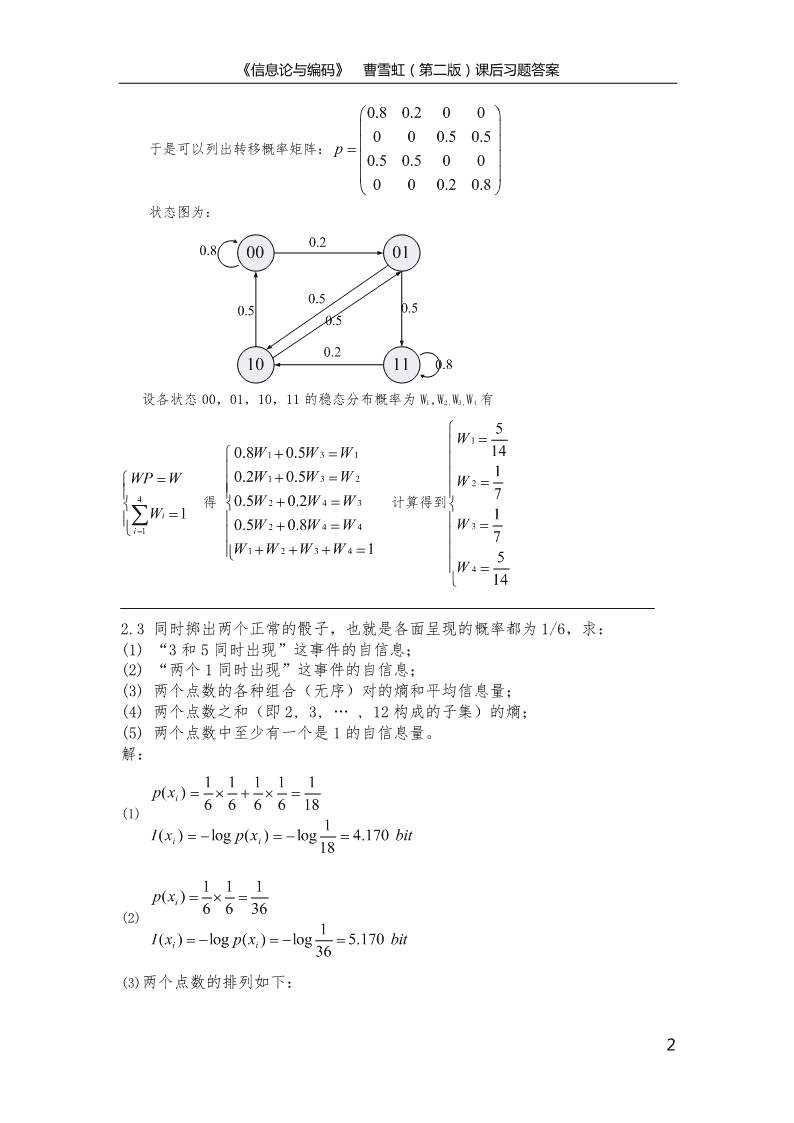

《信息论与编码》曹雪虹(第二版)课后习题答案0.80.200000.50.5于是可以列出转移概率矩阵:p0.50.500000.20.8状态图为:0.20.800010.50.50.50.50.210110.8设各状态00,01,10,11的稳态分布概率为W1,W2,W3,W4有5W10.8W10.5W3W1141WPW0.2W10.5W3W2W274得0.5W20.2W4W3计算得到Wi11i10.5W20.8W4W4W37W1W2W3W415W4142.3同时掷出两个正常的骰子,也就是各面呈现的概率都为1/6,求:(1)“3和5同时出现”这事件的自信息;(2)“两个1同时出现”这事件的自信息;(3)两个点数的各种组合(无序)对的熵和平均信息量;(4)两个点数之和(即2,3,…,12构成的子集)的熵;(5)两个点数中至少有一个是1的自信息量。解:11111p(x)i666618(1)1I(x)logp(x)log4.170bitii18111p(x)i6636(2)1I(x)logp(x)log5.170bitii36(3)两个点数的排列如下:2

《信息论与编码》曹雪虹(第二版)课后习题答案111213141516212223242526313233343536414243444546515253545556616263646566111共有21种组合:其中11,22,33,44,55,66的概率是6636111其他15个组合的概率是266181111H(X)p(xi)logp(xi)6log15log4.337bit/symboli36361818(4)参考上面的两个点数的排列,可以得出两个点数求和的概率分布如下:X2345678910111211115151111P(X)3618129366369121836H(X)p(xi)logp(xi)i1111111155112log2log2log2log2loglog363618181212993636663.274bit/symbol(5)1111p(x)11i663611I(x)logp(x)log1.710bitii362-4解:(1)红球,白球的个数均为50个,则随意取球得到的颜色的球是等概率事件:p=,信息量为:I()=-logp()=-log)=1bit(2)取红球所需的信息量为:I()=-logp()=-log=0.014bit取白球所需的信息量为:I()=-logp()=-log=6.64bit总信息量为:H(x)==log=0.081bit/symbol.(3)每个球取出的概率均为:p=所需的信息量:I()=-logp()=-log=2bit2-5居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米3

《信息论与编码》曹雪虹(第二版)课后习题答案以上的,而女孩子中身高160厘米以上的占总数的一半。假如我们得知“身高160厘米以上的某女孩是大学生”的消息,求:获得多少信息量?解:设随机变量X代表女孩子学历Xx1(是大学生)x2(不是大学生)P(X)0.250.75设随机变量Y代表女孩子身高Yy1(身高>160cm)y2(身高<160cm)P(Y)0.50.5已知:在女大学生中有75%是身高160厘米以上的即:p(y/x)0.75bit11求:身高160厘米以上的某女孩是大学生的信息量p(x)p(y/x)0.250.75111即:I(x/y)logp(x/y)loglog1.415bit1111p(y)0.512-6掷两颗骰子,当其向上的面的小圆点之和是3时,该消息包含的信息量是多少?当小圆点之和是7时,该消息所包含的信息量又是多少?解:11)因圆点之和为3的概率px()p(1,2)p(2,1)18该消息自信息量Ix()log()log184.170pxbit2)因圆点之和为7的概率1px()p(1,6)p(6,1)p(2,5)p(5,2)p(3,4)p(4,3)6该消息自信息量Ix()log()log62.585pxbitXx10x21x32x432.7设有一离散无记忆信源,其概率空间为P3/81/41/41/8(1)求每个符号的自信息量(2)信源发出一消息符号序列为{202120130213001203210110321010021032011223210},求该序列的自信息量和平均每个符号携带的信息量18解:Ix()1log2log21.415bitpx()13同理可以求得Ix()22bitIx,()23bitIx,()33bit因为信源无记忆,所以消息序列的信息量就等于该序列中各个符号的信息量之和就有:I14()13()12()6()87.81Ix1Ix2Ix3Ix4bit4

《信息论与编码》曹雪虹(第二版)课后习题答案87.81平均每个符号携带的信息量为1.95bit/symbol452.8试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍?解:四进制脉冲可以表示4个不同的消息,例如:{0,1,2,3}八进制脉冲可以表示8个不同的消息,例如:{0,1,2,3,4,5,6,7}二进制脉冲可以表示2个不同的消息,例如:{0,1}假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量H(X)lognlog42bit/symbol1八进制脉冲的平均信息量H(X)lognlog83bit/symbol2二进制脉冲的平均信息量H(X)lognlog21bit/symbol0所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。2-9解:(1)划出现的概率为:p()=,则点出现的概率p()=。所以,划出现的信息量:I()=-log=2bit,点出现的信息量:I()=-log=0.415bit(2)平均信息量:H(X)===0.811bit/symbol2-10(1)一次实验抽出白球的概率:p()==,抽出黑球的概率:p()=信息熵为:H(X)===0.918bit/symbol(2)P(黑/黑)=P(白/黑)=不确定度:H(Y/黑)=log+log=0.86bit/symbol(3)P(黑/白)=P(白/白)=不确定度:H(Y/白)=log+log=0.94bit/symbol(4)第一次取出的为白球的概率:P(黑)=,第一次取出的为白球的概率:P(白)=不确定度:H(Y)=log+log=0.914bit/symbol5

《信息论与编码》曹雪虹(第二版)课后习题答案2.11有一个可以旋转的圆盘,盘面上被均匀的分成38份,用1,…,38的数字标示,其中有两份涂绿色,18份涂红色,18份涂黑色,圆盘停转后,盘面上的指针指向某一数字和颜色。(1)如果仅对颜色感兴趣,则计算平均不确定度(2)如果仅对颜色和数字感兴趣,则计算平均不确定度(3)如果颜色已知时,则计算条件熵解:令X表示指针指向某一数字,则X={1,2,…,38}Y表示指针指向某一种颜色,则Y={绿色,红色,黑色}Y是X的函数,由题意可知pxy(ij)px()i312381838(1)HY()py()logjlog2log1.24bit/symbolj1py()j3823818(2)HXY(,)HX()log385.252bit/symbol(3)HXY(|)HXY(,)HY()HX()HY()5.251.244.01bit/symbol2.12两个实验X和Y,X={x1x2x3},Y={y1y2y3},l联合概率rxyi,jrij为:r11r12r137/241/240rrr1/241/41/24212223rrr01/247/24313233(1)如果有人告诉你X和Y的实验结果,你得到的平均信息量是多少?(2)如果有人告诉你Y的实验结果,你得到的平均信息量是多少?(3)在已知Y实验结果的情况下,告诉你X的实验结果,你得到的平均信息量是多少?解:联合概率pxy(,)ij为Y1y2y3Xy1HXY(,)pxy(,)logij2ijpxy(,)ijx17/241/240724112log24log242log42x21/241/41/24247244x301/247/24=2.3bit/symbolXY的概率分布:Xx1x2x3H(X|Y)=H(X,Y)-H(Y)=2.3-1.58=0.72bit/symbolP8/248/248/241Y8/248/248/24HY()3log31.582bit/symbol3P8/248/248/242.13有两个二元随机变量X和Y,它们的联合概率为:6

《信息论与编码》曹雪虹(第二版)课后习题答案YX=01/83/8=13/81/8并定义另一随机变量Z=XY(一般乘积),试计算:(1)H(X),H(Y),H(Z),H(XZ),H(YZ)和H(XYZ);(2)H(X/Y),H(Y/X),H(X/Z),H(Z/X),H(Y/Z),H(Z/Y),H(X/YZ),H(Y/XZ)和H(Z/XY);(3)I(X;Y),I(X;Z),I(Y;Z),I(X;Y/Z),I(Y;Z/X)和I(X;Z/Y)。解:(1)131311p(x)p(xy)p(xy)\p(x)p(xy)p(xy)1111222122882882H(X)p(xi)logp(xi)1bit/symboli131311p(y)p(xy)p(xy)\p(y)p(xy)p(xy)1112121222882882H(Y)p(yj)logp(yj)1bit/symboljZ=XY的概率分布如下:Zz10z2171P(Z)8827711H(Z)p(zk)loglog0.544bit/symbolk8888p(x)p(xz)p(xz)11112p(xz)012p(xz)p(x)0.5111p(z)p(xz)p(xz)1112173p(xz)p(z)p(xz)0.52111188p(z)p(xz)p(xz)212221p(xz)p(z)2228H(XZ)p(xizk)logp(xizk)ik113311logloglog1.406bit/symbol2288887

《信息论与编码》曹雪虹(第二版)课后习题答案p(y)p(yz)p(yz)11112p(yz)012p(yz)p(y)0.5111p(z)p(yz)p(yz)1112173p(yz)p(z)p(yz)0.52111188p(z)p(yz)p(yz)212221p(yz)p(z)2228113311H(YZ)p(yjzk)logp(yjzk)logloglog1.406bit/symboljk228888p(xyz)0112p(xyz)0122p(xyz)0212p(xyz)p(xyz)p(xy)11111211p(xyz)p(xy)1/811111p(xyz)p(xyz)p(xz)12111111113p(xyz)p(xz)p(xyz)12111111288p(xyz)p(xyz)p(xy)211212213p(xyz)p(xy)211218p(xyz)0221p(xyz)p(xyz)p(xy)221222221p(xyz)p(xy)222228H(XYZ)p(xiyjzk)log2p(xiyjzk)ijk11333311loglogloglog1.811bit/symbol88888888(2)11333311H(XY)p(xiyj)log2p(xiyj)loglogloglog1.811bit/symbolij88888888H(X/Y)H(XY)H(Y)1.81110.811bit/symbolH(Y/X)H(XY)H(X)1.81110.811bit/symbolH(X/Z)H(XZ)H(Z)1.4060.5440.862bit/symbolH(Z/X)H(XZ)H(X)1.40610.406bit/symbolH(Y/Z)H(YZ)H(Z)1.4060.5440.862bit/symbolH(Z/Y)H(YZ)H(Y)1.40610.406bit/symbolH(X/YZ)H(XYZ)H(YZ)1.8111.4060.405bit/symbolH(Y/XZ)H(XYZ)H(XZ)1.8111.4060.405bit/symbolH(Z/XY)H(XYZ)H(XY)1.8111.8110bit/symbol(3)8

《信息论与编码》曹雪虹(第二版)课后习题答案I(X;Y)H(X)H(X/Y)10.8110.189bit/symbolI(X;Z)H(X)H(X/Z)10.8620.138bit/symbolI(Y;Z)H(Y)H(Y/Z)10.8620.138bit/symbolI(X;Y/Z)H(X/Z)H(X/YZ)0.8620.4050.457bit/symbolI(Y;Z/X)H(Y/X)H(Y/XZ)0.8620.4050.457bit/symbolI(X;Z/Y)H(X/Y)H(X/YZ)0.8110.4050.406bit/symbol2-14(1)p(j/i)=p(i,j)=p(i/j)=p()=+=p()=+=(2)方法1:I(X;Y)=p()|I(X;)+p()|I(X;)=0.311bit方法2:I(X;Y)=log()+log()+log()+log()=0.311bit2-15由题意可得:p(j/i)=p()=p()=p()===1-I()=log()=log()=log[2(1-)]p()==信息量为:I()=log()=log()=log(2)2.16黑白传真机的消息元只有黑色和白色两种,即X={黑,白},一般气象图上,黑色的出现概率p(黑)=0.3,白色出现的概率p(白)=0.7。(1)假设黑白消息视为前后无关,求信源熵H(X),并画出该信源的香农线图(2)实际上各个元素之间是有关联的,其转移概率为:P(白|白)=0.9143,P(黑|白)=0.0857,P(白|黑)=0.2,P(黑|黑)=0.8,求这个一阶马尔可夫信源的信源熵,并画出该信源的香农线图。(3)比较两种信源熵的大小,并说明原因。1010解:(1)HX()0.3log220.7log0.8813bit/symbol370.70.3黑白0.70.3P(黑|白)=P(黑)9

《信息论与编码》曹雪虹(第二版)课后习题答案P(白|白)=P(白)P(黑|黑)=P(黑)P(白|黑)=P(白)(2)根据题意,此一阶马尔可夫链是平稳的(P(白)=0.7不随时间变化,P(黑)=0.3不随时间变化)1H()XHX(2|X1)pxy(,)logij2ijpxy(,)ij1110.91430.7log20.08570.7log20.20.3log20.91430.08570.210.80.3log20.8=0.512bit/symbol52.17每帧电视图像可以认为是由310个像素组成的,所有像素均是独立变化,且每像素又取128个不同的亮度电平,并设亮度电平是等概率出现,问每帧图像含有多少信息量?若有一个广播员,在约10000个汉字中选出1000个汉字来口述此电视图像,试问广播员描述此图像所广播的信息量是多少(假设汉字字汇是等概率分布,并彼此无依赖)?若要恰当的描述此图像,广播员在口述中至少需要多少汉字?解:(1)H(X)lognlog1287bit/symbol22N56H(X)NH(X)31072.110bit/symbol(2)H(X)lognlog1000013.288bit/symbol22NH(X)NH(X)100013.28813288bit/symbol(3)N6H(X)2.110N158037H(X)13.2882.19解:由=1得k=1/2所以(X)==1.44bit/symbol10

《信息论与编码》曹雪虹(第二版)课后习题答案1x2.20给定语音信号样值X的概率密度为px()e,x,求2Hc(X),并证明它小于同样方差的正态变量的连续熵。解:1xHXc()pxx()logpxdxx()pxx()logedx21pxxx()logdxpx()(x)logedx211xloglogee(xdx)22011xx1loglogee(xdx)loge(xdx)2220112xlog2logexedx2201xlogloge(1xe)2012eloglogelog22EX()0,()DX2,1214e2e2eeHX()log2elogloglogHX()22222.24连续随机变量X和Y的联合概率密度为:1222xyr2p(x,y)r,求H(X),H(Y),H(XYZ)和I(X;Y)。0其他(提示:2logsinxdxlog2)2202解:11

《信息论与编码》曹雪虹(第二版)课后习题答案222222rxrx12rxp(x)p(xy)dydy(rxr)r2x2r2x222rrrH(X)p(x)logp(x)dxcr22r2rxp(x)logdxrr2r2r22p(x)logdxp(x)logrxdxrr2r2rr22logp(x)logrxdx2r2r1loglogr1loge2221logrlogebit/symbol222其中:r22p(x)logrxdxr22r2rx22logrxdxrr24r2222rxlogrxdxr2040令xrcosrsinlogrsind(rcos)2r24022rsinlogrsind2r2422sinlogrsind0422422sinlogrdsinlogsind0041cos241cos2logr2d2logsind020212

《信息论与编码》曹雪虹(第二版)课后习题答案2222logr2dlogr2cos2d2logsind2cos2logsind0000122logrlogr2dsin2(log2)2cos2logsind02022logr12cos2logsind01logr1loge22其中:2112cos2logsind2logsindsin2sin2logsin22sin2dlogsin0000122sincoscoslog2ed2loge2cos2d2loge21cos2d02020sin211111loge2dloge2cos2dlogelogesin22loge20202222022222222ryry12ryp(y)p(xy)dxdx(ryr)r2y2r2y2r2r2p(y)p(x)1H(Y)H(X)logrlogebit/symbolCC222H(XY)p(xy)logp(xy)dxdycR1p(xy)logdxdyr2R2logrp(xy)dxdyR2logrbit/symbol2I(X;Y)H(X)H(Y)H(XY)cccc22logrlogelogr22loglogebit/symbol222.25某一无记忆信源的符号集为{0,1},已知P(0)=1/4,P(1)=3/4。(1)求符号的平均熵;(2)有100个符号构成的序列,求某一特定序列(例如有m个“0”和(100-m)个“1”)的自信息量的表达式;(3)计算(2)中序列的熵。13

《信息论与编码》曹雪虹(第二版)课后习题答案解:(1)符号的平均熵:1133H(X)p(xi)logp(xi)loglog0.811bit/symboli4444(2)自信息量的表达式为:m100m100m133p(xi)100444100m3I(x)logp(x)log41.51.585mbitii1004(3)序列的熵:100H(X)100H(X)1000.81181.1bit/symbol2-26解:p(j/i)=p(i)=p(i,j)=H(I,J)=4log(8)+2log(10)+2log(15+3×)log(36)+log(12)=3.415bit/symbol▲2.29有一个一阶平稳马尔可夫链XX1,2,,Xr,,各Xr取值于集合Aaaa1,2,3,已知起始概率P(Xr)为p11/2,p2p31/4,转移概率如下图所示j123i11/21/41/422/301/332/31/30(1)求(XXX1,2,3)的联合熵和平均符号熵(2)求这个链的极限平均符号熵(3)求HHH0,,12和它们说对应的冗余度解:(1)HXXX(1,2,3)HX(1)HX(2|X1)HX(3|XX2,1)HX(1)HX(2|X1)HX(3|X2)14

《信息论与编码》曹雪虹(第二版)课后习题答案111111HX(1)logloglog1.5bit/symbol224444X1,X2的联合概率分布为123pxx()12ijpx(2j)pxx(12ij)i11/41/81/8X2的概率分布为21/601/1212331/61/12014/245/245/24111131131HX(21|X)log4log4log4loglog3loglog348862126212=1.209bit/symbolX2,X3的联合概率分布为123pxx()23ij17/247/487/4825/3605/1235/365/120771535535HX(32|X)log2log4log4loglog3loglog3244883627236272=1.26bit/symbolHXXX(1,2,3)1.51.2091.263.969bit/符号3.969所以平均符号熵HXXX3(1,2,3)1.323bit/符号3(2)设a1,a2,a3稳定后的概率分布分别为W1,W2,W3,转移概率距阵为1111224W1W2W31W1244233721WPW113P0由得到W1W3W2计算得到W233Wi1431421W1W2W3130W33314又满足不可约性和非周期性34111321H()XWHXWii(|)H(,,)2H(,,0)1.25bit/symboli172441433(3)H0log31.58bit/symbolH11.5bit/symbol15

《信息论与编码》曹雪虹(第二版)课后习题答案1.51.209H21.355bit/symbol21.251.2500110.2111110.6171.581.51.2522110.0781.3551/2a11/42/31/42/31/3a2a31/3▲2-30解:(1)求平稳概率P(j/i)=解方程组=+=1得到=(2)H(S/)=log()+log(3)=0.918bit/symbolH(S/)=0信源熵为:H(S)=H(S/)+H(S/)=×0.918+×0=0.688bit/symbol▲2-31解:转移矩阵P(j/i)=解方程组得到=,=,=H()=log(3)=1.585bit/symbolH()=log(3)=1.585bit/symbol16

《信息论与编码》曹雪虹(第二版)课后习题答案H()=log(2)=1bit/symbol(X)=H()+H()+H()=1.439bit/symbol▲2.32一阶马尔可夫信源的状态图如图所示,信源X的符号集为:(0,1,2)。(1)求信源平稳后的概率分布P(0),P(1),P(2)(2)求此信源的熵(3)近似认为此信源为无记忆时,符号的概率分布为平稳分布。求:近似信源的熵H(X)并与H进行比较1-p1-pp/201p/2p/2p/2p/2p/221-p图2-131pp/2p/2解:根据香农线图,列出转移概率距阵Pp/21pp/2p/2p/21p令状态0,1,2平稳后的概率分布分别为pp1(1pW)1W2W3W1W223WPWpp13得到W1(1pW)2W3W2计算得到WWi1223i1W1W2W311W3由齐次遍历可得:1pp12H()XWHXWii(|)3H(1p,,)(1p)logplogi3221pp,HX()log31.58bit/符号由最大熵定理可知HX()存在极大值或者也可以通过下面的方法得出存在极大值:H()X1pp21plog(1pp)(1)loglogp1p2p22(1p)17

《信息论与编码》曹雪虹(第二版)课后习题答案p11pp又01p所以0,当p=2/3时12(1pp)22(1)2(1p)2(1p)H()Xp0

您可能关注的文档

- 信息技术考试试题库(完整版含答案).doc

- 信息检索练习题及答案.doc

- 信息管理学教程课后习题答案.pdf

- 信息系统分析与设计课后题答案(杨选辉).doc

- 信息编码习题答案或提示.doc

- 信息论与编码(第二版)曹雪虹(最全版本)答案.doc

- 信息论与编码-曹雪虹-课后习题答案.doc

- 信息论与编码习题解答(待校200812).doc

- 信息论与编码答案.doc

- 修改后《2004-2012_安全生产技术》真题+答案.doc

- 修改宋献中:《中级财务管理》习题答案.doc

- 傅建熙-《有机化学》课后习题答案.doc

- 傅建熙《有机化学》课后习题答案 (1).doc

- 傅建熙《有机化学》课后习题答案.doc

- 傅建熙《有机化学》课后习题答案.pdf

- 傅建熙《有机化学》课后习题答案西北农林科技大学版.doc

- 光学 姚启钧版 习题解答3.4.doc

- 光学(赵凯华)习题解答.pdf

相关文档

- 施工规范CECS140-2002给水排水工程埋地管芯缠丝预应力混凝土管和预应力钢筒混凝土管管道结构设计规程

- 施工规范CECS141-2002给水排水工程埋地钢管管道结构设计规程

- 施工规范CECS142-2002给水排水工程埋地铸铁管管道结构设计规程

- 施工规范CECS143-2002给水排水工程埋地预制混凝土圆形管管道结构设计规程

- 施工规范CECS145-2002给水排水工程埋地矩形管管道结构设计规程

- 施工规范CECS190-2005给水排水工程埋地玻璃纤维增强塑料夹砂管管道结构设计规程

- cecs 140:2002 给水排水工程埋地管芯缠丝预应力混凝土管和预应力钢筒混凝土管管道结构设计规程(含条文说明)

- cecs 141:2002 给水排水工程埋地钢管管道结构设计规程 条文说明

- cecs 140:2002 给水排水工程埋地管芯缠丝预应力混凝土管和预应力钢筒混凝土管管道结构设计规程 条文说明

- cecs 142:2002 给水排水工程埋地铸铁管管道结构设计规程 条文说明